OpenAI Build Hour: GPT Realtime 2.0 技術発表と企業実践に関する分析レポート

1. 概要 (Overview)

- テーマ:GPT Realtime 2.0 の新機能発表および音声 AI エージェント(Voice Agents)の生産性向上への応用。

- 開催日:2026年5月13日

- 主な登壇者:

- Sarah Urbanus:OpenAI スタートアップ・マーケティング責任者(司会)。

- Terry:OpenAI マルチモーダル HCI エキスパート。

- Erica:OpenAI ソリューション・エンジニア。

- Ken Murphy & Soham:Sierra チーム(企業向け AI エージェント・パートナー)。

2. エグゼクティブ・サマリー (Executive Summary)

本セッションでは、低遅延かつ高度な推論能力に特化した音声対話モデル・ソリューション「GPT Realtime 2.0」が正式に発表されました。このバージョンでは、指示遂行能力(Instruction Following)、ツール呼び出し(Tool Calling)、多言語パフォーマンスが大幅に向上し、遅延は 200 ミリ秒レベルまで短縮されています。EC ショッピング・アシスタントや製品分析ダッシュボードのデモンストレーションを通じて、OpenAI は「音声からアクションへ(Voice-to-Action)」というシームレスな体験を提示しました。また、パートナーの Sierra 社からは、複雑なエンタープライズ環境で音声 AI の信頼性と安全性を確保するための「Agent Harness」アーキテクチャが共有されました。

3. 詳細な議題の解説 (Detailed Discussion Points)

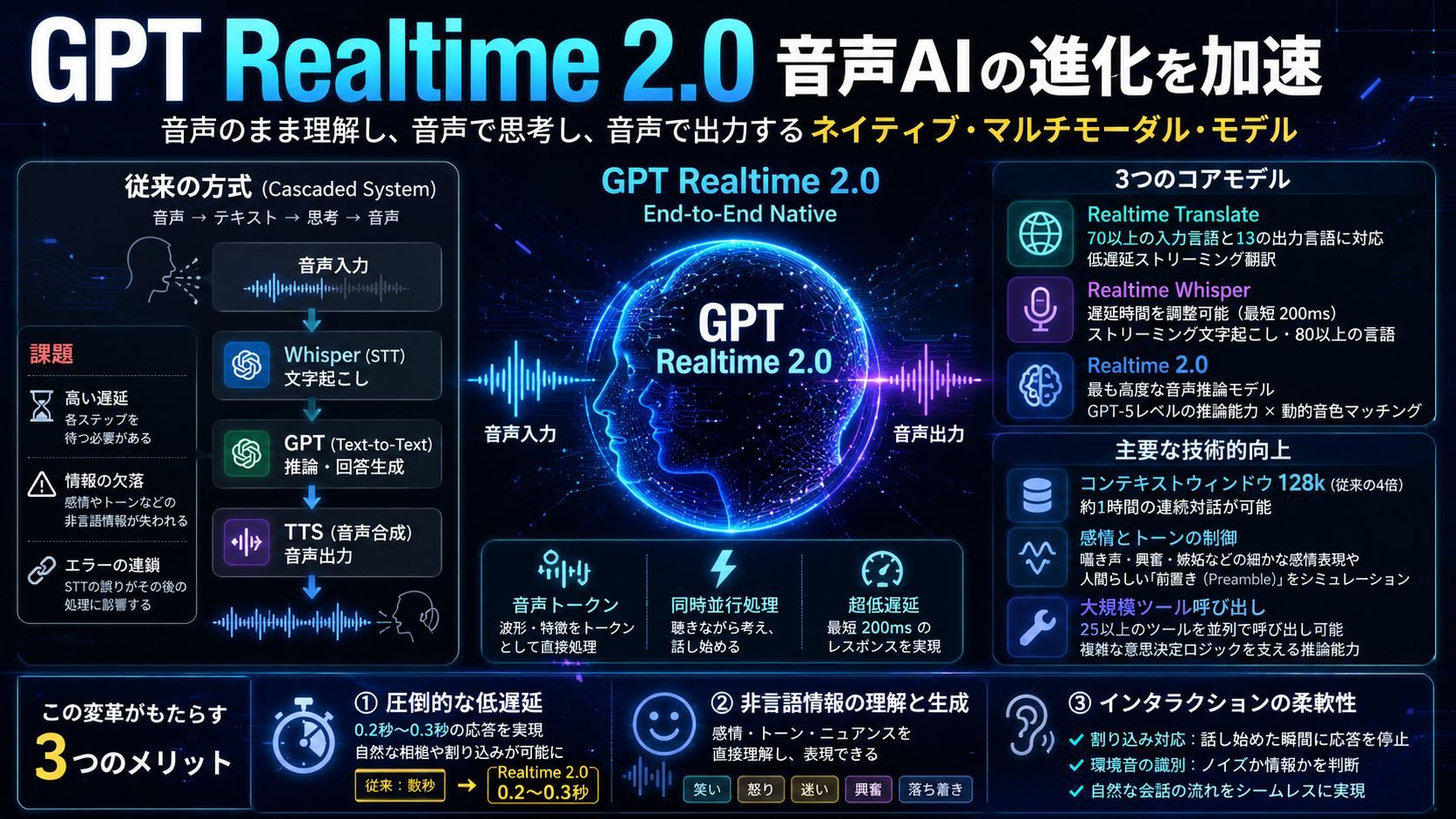

A. GPT Realtime 2.0 モデル能力の進化

- 3つのコアモデル:

- Realtime Translate:70以上の入力言語と13の出力言語に対応した、低遅延ストリーミング翻訳。

- Realtime Whisper:遅延時間を調整可能(最短 200ms)なストリーミング文字起こし。80以上の言語をサポート。

- Realtime 2.0:最も高度な音声推論モデル。GPT-5 レベルの推論能力を音声に導入し、動的な音色マッチングをサポート。

- 主要な技術的向上:

- コンテキストウィンドウ:従来の 4 倍となる 128k に拡大。約 1 時間の連続対話が可能。

- 感情とトーンの制御:囁き声、興奮、嫉妬といった細かな感情表現や、人間らしい「前置き(Preamble)」のシミュレーションが可能。

- ツール呼び出し:25 以上のツールを並列で呼び出す大規模ツールライブラリに対応し、複雑な意思決定ロジックを支える推論能力を保持。

B. デモ:音声駆動型スマート EC(SupplyCo)

- 背景:ハイキング旅行の準備をしているユーザーが、音声エージェントを通じて装備を購入するシナリオ。

- 技術的ハイライト:

- エージェントがユーザーの注文履歴を確認(靴下や水筒の購入済みアイテムを把握)。

- ウェブ上のレビューをリアルタイムで検索(特定のテントの防水性に関する低評価レビューを識別)。

- 外部の天気 API を呼び出し、目的地の降水予報に基づいた適切なアドバイスを提供。

- 結論:音声エージェントは単なる「会話」に留まらず、UI を直接操作し、複雑なフィルタリング・ロジックを実行可能。

C. デモ:製品分析ダッシュボード(Metric Loop)

- 背景:プロダクトマネージャーが音声で動的ダッシュボードを操作し、欧州地域でのアクティブ率低下の原因を分析するシナリオ。

- 技術的ハイライト:

- 音声からアクションへ:音声指示に基づいてダッシュボードのフィルタリング操作を自動実行。

- 根本原因分析:エージェントがセッション・リプレイやサポート・チケットを自動調査し、モバイル版 Safari の特定バージョンにおけるサイズ選択機能の不具合を特定。

- ウェイクワードとミュートロジック:静かにするように指示された際の高い自律性と、環境ノイズに対する耐性を実証。

D. エンタープライズ実践事例 (Sierra Team)

- 課題:フォーチュン 100 企業において、0.1% のエラー率もビジネス上の重大なリスクに繋がる。

- ソリューション:

- Agent Harness:モデルの外側にインフラを構築し、ワークフローのオーケストレーション、ツールの制約、ブランドの一貫性、個人情報(PII)の匿名化を管理。

- VAD(音声活動検知)のチューニング:騒音下(高速道路や子供のいる車内)でもユーザーの発話終了を正確に判定。

- 状態の回復(State Recovery):通話の中断に備え、セッションを跨いでコンテキストを維持する機能。

4. 主要な決定事項 (Key Decisions)

- モデルのポジショニング:従来の「音声→テキスト→音声」というカスケード型から、ネイティブな「音声から音声へ」のエンドツーエンド・アーキテクチャへ移行。遅延と情報損失を解消。

- アプリケーションの方向性:単なる音声チャットではなく、「Voice-to-Action(音声による実行)」の推進に重点を置く。

- 開放性:GPT Realtime 2.0 の API、SDK、Playground を開発者向けに即時公開。

5. アクションアイテム (Action Items)

| 具体的なタスク | 担当者 | 備考 |

|---|---|---|

| 技術ドキュメントとコードサンプルの確認 | 全開発者 | OpenAI 公式 Build Hour リポジトリを参照 |

| 新版 VAD パラメータの検証 | 音声アプリ開発者 | 各種ハードウェア(マイク/PC)での検知精度テスト |

| 次回の Build Hour への参加 | 登録ユーザー | テーマ:Agents SDK(5月28日開催) |

| 128k コンテキスト戦略の統合 | 既存顧客 | 長時間の通話における情報の想起精度を最適化 |

6. 潜在的なリスクとインサイト (Risks & Insights)

- 割り込み処理(Interruptions):音声対話における最大の難関。OpenAI は、法的免責事項の読み上げ中など、特定のタイミングでの割り込み禁止ロジックを提供。

- 推論と速度のトレードオフ:Realtime 2.0 は高速だが、極めて複雑なシナリオでは、バックグラウンドで GPT-4o 等の強力なテキストモデルが対話品質を監視する「非同期スーパーバイザー・モード」を推奨。

- グローバル・トレンド:ブラジルやインドなど、モバイル・ファーストの国々では音声対話の受容性がテキストよりも高く、大きな成長機会がある。

- モデルのハルシネーション:名前や電話番号のスペルといった正確性が求められるタスクでは依然としてエラーのリスクがある。UI による確認や、厳格な構造化推論の制約を組み合わせることが推奨される。

GPT Realtime 2.0: アーキテクチャの変革とその意義

GPT Realtime 2.0 は音声データを「テキストに変換してから考える」のではなく、「音声のまま理解し、音声で思考し、音声で出力する」ネイティブ・マルチモーダル・モデルです。

1. アーキテクチャの比較

従来の方式 (Cascaded System)

複数のモデルを数珠つなぎ(Pipeline)にする方式です。

- 処理の流れ: 音声入力 → Whisper (STT) → GPT (Text-to-Text) → TTS (音声合成)

- 課題:

- 高い遅延: 各ステップが完了するのを待つ必要があるため、会話に「間」が生まれる。

- 情報の欠落: テキスト化する過程で、話者の「感情」「皮肉」「強調」「声の震え」といった非言語情報がすべて削ぎ落とされる。

- エラーの連鎖: 最初の文字起こし(STT)で誤字があると、その後の GPT の回答もズレてしまう。

GPT Realtime 2.0 (End-to-End Native)

単一のモデルが音声トークンを直接処理する方式です。

- 処理の流れ: 音声入力 → GPT Realtime 2.0 → 音声出力

- 変革の核心:

- 音声トークン: モデルがテキスト(文字)だけでなく、音声の波形や特徴を「トークン」として直接処理します。

- 同時並行処理: 聴きながら考え、話し始めることが可能なため、200ms という人間と同等のレスポンス速度を実現しています。

2. この変革がもたらす 3 つのメリット

① 圧倒的な低遅延 (Latency)

中間生成(テキスト化)を挟まないため、従来の方式では数秒かかっていた応答が、0.2秒〜0.3秒まで短縮されました。これにより、自然な「相槌」や「割り込み」が可能になります。

② 非言語情報の理解と生成 (Prosody & Emotion)

- 理解: ユーザーが笑っているのか、怒っているのか、迷っているのか(語尾のニュアンス)を直接理解します。

- 表現: モデルも「囁き声」「興奮したトーン」「落ち着いたトーン」などを使い分けることができ、より人間らしいコミュニケーションが可能になります。

③ インタラクションの柔軟性

音声が直接処理されるため、以下のような高度な制御が容易になります。

- 割り込み対応: ユーザーが話し始めた瞬間にモデルが発話を止め、次の指示を聞き始める。

- 環境音の識別: 背景で鳴っている音(サイレンやタイピング音)をノイズとして無視するのか、情報として取り込むのかを判断できる。

結論

今回のアップデートは単なる「高速化」ではなく、AI が「耳」と「声」を脳の一部として手に入れた、根本的な進化であると言えます。

GPT Realtime 2.0 開発スタートガイド

GPT Realtime 2.0(Realtime API)は、WebSocketを使用してデバイスと OpenAI のサーバー間で低遅延の双方向ストリーミングを実現します。

ステップ 1:OpenAI Playground で試す(コード不要)

まずは、コードを書かずにブラウザ上でモデルの性能(反応速度や声の質)を確認しましょう。

- OpenAI Dashboard にログインします。

- 左メニューから 「Playground」 を選択します。

- モードを 「Realtime」 に切り替えます。

- マイクの使用を許可し、右側の設定でモデル(例:gpt-4o-realtime-preview)と声(Alloy, Echo, Shimmer など)を選択します。

- 「Connect」 を押して話しかけてみてください。

ステップ 2:開発環境の準備

実際にアプリケーションを構築するには、APIキーと特定のライブラリが必要です。

必要なもの

- OpenAI API Key: API Keys から作成。

- Tier 1 以上の支払い実績: Realtime API は現在、有料利用実績のあるアカウントで利用可能です。

- Node.js または Python: 公式 SDK が提供されています。

ステップ 3:公式リファレンスとサンプルコード

OpenAI は今回の Build Hour に合わせて、非常に参考になるリポジトリを公開しています。

- openai-realtime-console:

- React ベースのフル機能デモアプリです。

- 音声の可視化(波形)、ツール呼び出し(Function Calling)、ログの確認方法がすべて含まれています。

- openai-realtime-api-dotnet / python / node:

- 各言語の最新 SDK。

ステップ 4:実装の基本概念

Realtime API は従来の fetch (HTTP) ではなく、WebSocket を使います。以下の 3 つの「イベント」を制御するのが基本です。

- Session Update:

- エージェントの性格、使用するツール(関数)、声の種類、割り込みを許可するかどうかを設定します。

- Item Create / Response Create:

- ユーザーの音声入力やテキスト入力を送信し、モデルに応答をリクエストします。

- Server Events:

- サーバーから送られてくる response.audio.delta(音声の断片)をクライアント側で再生します。

ステップ 5:おすすめの学習パス

- まずは公式コンソールをローカルで動かす:

git clone して npm start するだけで、デモで見られたような「音声で動くダッシュボード」に近い環境が手に入ります。 - Function Calling を試す:

「現在の天気を教えて」と言ったときに、自分の定義した関数が呼ばれるフローを実装します。 - VAD (Voice Activity Detection) の調整:

「いつユーザーが話し終わったか」を自動検知するか、手動(プッシュ・トゥ・トーク)にするかをアプリに合わせて調整します。

注意点

- コスト: 音声トークンはテキストトークンよりも単価が高いため、開発中は短い会話でテストすることをお勧めします。

- セキュリティ: APIキーをブラウザ側(フロントエンド)に直接書くと盗まれるリスクがあるため、本番環境ではサーバー側を経由するか、エフェメラル・トークン(使い捨てトークン)を使用してください。